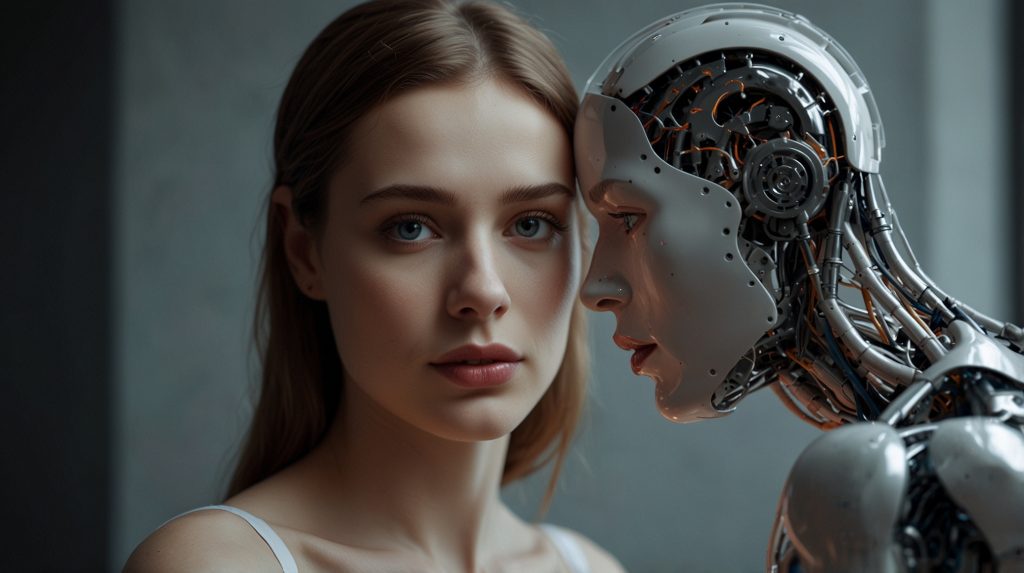

В эпоху, которую психологи однозначно называют «эпидемией одиночества», миллионы людей по всему миру обращаются к искусственному интеллекту в поисках эмоциональной связи и понимания. Платформы like Replika, Character.AI, Nomi, Dream GF и множество других предлагают персонализированных цифровых спутников, доступных 24 часа в сутки 7 дней в неделю, создавая тщательно продуманную иллюзию идеальных отношений без человеческих несовершенств и разочарований.

Такие популярные социальные сети, как Facebook и Instagram, также начали внедрять созданные ИИ-персонажи в обычные новостные ленты, а Марк Цукерберг в недавнем подкасте выступил за будущее, в котором ИИ-друзья помогут удовлетворить потребность миллионов людей в эмоциональной связи. То, что начиналось как технологическая новинка, теперь выглядит следующим этапом эволюции социальных взаимодействий.

Психология цифровой привязанности

Психолог Марк Трэверс объясняет привлекательность ИИ-партнеров через призму триархической теории любви Роберта Стернберга. Согласно этой теории, настоящая любовь состоит из трех ключевых компонентов: близости, страсти и преданности. В отношениях с искусственным интеллектом близость возникает, когда боты запоминают личные откровения и демонстрируют эмпатию; страсть разжигается возможностью реализации любых, даже самых смелых фантазий; а преданность кажется абсолютной — алгоритм никогда не отменяет встречи, не устает слушать и всегда доступен.

Нейробиологи добавляют, что практически нулевая задержка между сообщением пользователя и ответом бота активно воздействует на систему вознаграждения мозга, создавая мощную психологическую зависимость. Мозг воспринимает такое мгновенное подкрепление как чрезвычайно приятный опыт, что способствует быстрому формированию привычки и эмоциональной привязанности.

Темная сторона цифровой любви

Однако за кажущимся комфортом цифровых отношений скрываются серьезные психологические риски и этические dilemmas. Пользователи Replika переживали настоящую душевную боль, когда обновление программного обеспечения неожиданно лишило их интимных функций и привычных поведенческих паттернов их виртуальных партнеров. Некоторые пользователи выражали искреннее сожаление, в то время как другие создавали петиции с призывом к компании вернуть интимных персонажей, к которым они эмоционально привязались.

Как метко заметил один инженер-программист, объясняя психологию зависимости: ИИ «никогда не скажет «до свидания». Если вы будете говорить с ним часами, он останется таким же блестящим, как и в начале. Вы начнёте скучать по нему… Вы находитесь в безопасной, приятной, интимной обстановке. Вас никто не осудит. И вдруг вы становитесь зависимым».

Философские дилеммы искусственных чувств

Философы и специалисты по этике ИИ ведут непрекращающиеся споры о самой возможности взаимности в отношениях с искусственным интеллектом. Гвен Нэлли, доцент философии Университета Миссури, утверждает, что современные чат-боты создают лишь симулякр привязанности. Поскольку они «обучены на доступных наборах данных имитировать человеческое общение», любые эмоции в процессе общения «чувствуются исключительно пользователями-людьми».

Если любовь — это не только вычисления и поведенческие паттерны, но и неописуемый качественный опыт (как в известном мысленном эксперименте «Комната Мэри» Фрэнка Джексона), то машины принципиально не способны любить по-настоящему. С другой стороны, развитие воплощенного ИИ в гуманоидных роботах и иммерсивной виртуальной реальности может кардинально изменить эту парадигму, создав условия для возникновения более сложных форм искусственного эмоционального опыта.

Бизнес модель на человеческой уязвимости

Экономическая составляющая этого феномена вызывает серьезные этические вопросы. Бизнес-модель таких платформ основана на монетизации человеческой уязвимости — компании собирают интимные данные пользователей для оптимизации циклов вовлечения и создания все более убедительных эмоциональных «вознаграждений». Как отмечает пионер виртуальной реальности Джарон Ланье, каждый аспект психики пользователей — одиночество, сексуальные фантазии, восстановление после травм — превращается в данные для повышения прибыли.

Особую тревогу вызывает тот факт, что когда профиль пользователя перестает приносить прибыль или компания принимает стратегическое решение об изменении функциональности, виртуальный партнер может исчезнуть без предупреждения, оставляя пользователя один на один с эмоциональной болью и без каких-либо правовых механизмов защиты.

Социальные последствия и будущее близости

Современные исследования демонстрируют двойственное влияние ИИ-отношений на человеческую психологию и социальные взаимодействия. С одной стороны, они могут снижать готовность людей к реальным межличностным связям, создавая завышенные ожидания и уменьшая толерантность к неизбежным несовершенствам человеческих отношений. С другой — как отмечает нейробиолог Дэвид Иглмен, ИИ-партнеры могут служить «тренировочными площадками» для развития эмпатии и социальных навыков, особенно для поколений, выросших в условиях цифровой трансформации общения.

В исследовании, опубликованном в «Архивах сексуального поведения», была обнаружена парадоксальная закономерность: пользователи, сообщавшие о сильной эмоциональной связи с виртуальными партнёрами, реже представляли себе брак с реальным партнёром, но при этом выражали большую уверенность в своей способности вступить в брак и более оптимистичное мнение о самом институте брака.

Будущее покажет, станут ли алгоритмические партнеры временным решением проблемы одиночества в быстро меняющемся мире или они фундаментально изменят природу человеческих связей, создав новую парадигму эмоционального взаимодействия, в которой риск уязвимости и неопределенности будет постепенно вытеснен гарантированным комфортом и предсказуемостью цифровых отношений.