Энтропия — это мера беспорядка или количества возможных состояний системы. Согласно второму закону термодинамики, в замкнутой системе энтропия со временем растёт. Это означает, что процессы естественным образом идут от порядка к более вероятному, «рассеянному» состоянию.

Что означает слово «энтропия»

В повседневной речи энтропию часто называют мерой хаоса. Это упрощение, но в целом верное. В физике энтропия показывает, насколько много способов существует для расположения частиц в системе при одинаковых внешних условиях. Чем больше возможных микросостояний, тем выше энтропия.

Например, аккуратно сложенные книги на полке — это состояние с низкой энтропией. Если их случайно разбросать, вариантов расположения станет гораздо больше, а значит, энтропия возрастёт.

Почему энтропия всегда растёт

Второй закон термодинамики говорит, что в замкнутой системе энтропия не уменьшается. Это не запрет, а статистическая закономерность. Просто состояний с «беспорядком» намного больше, чем строго упорядоченных. Поэтому система естественным образом стремится к более вероятному состоянию.

Когда горячая вода остывает, тепло равномерно распределяется между молекулами окружающей среды. Это более вероятное состояние, чем сосредоточение энергии в одном месте.

Связь с временем

Рост энтропии определяет направление времени. Мы воспринимаем время как движение от прошлого к будущему именно потому, что наблюдаем необратимые процессы — остывание, смешивание, разрушение.

Если бы энтропия могла самопроизвольно уменьшаться, мы бы видели, как дым возвращается в сигарету, а разбитое стекло собирается обратно.

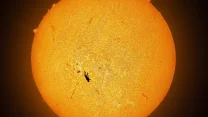

Энтропия во Вселенной

На космическом уровне энтропия тоже играет ключевую роль. Звёзды светят, потому что внутри них существуют температурные различия. Но по мере распределения энергии во Вселенной энтропия увеличивается. Это лежит в основе идеи «тепловой смерти» — гипотетического состояния, при котором энергия станет равномерной, а процессы прекратятся.

Энтропия — это не просто «хаос», а фундаментальная характеристика вероятности состояний системы. Она объясняет, почему процессы идут в одном направлении и почему порядок требует затрат энергии. Понимание энтропии помогает увидеть, как устроена не только термодинамика, но и сама стрела времени.

Интересные факты

- Понятие энтропии было введено в XIX веке в рамках термодинамики.

- В статистической физике энтропия связана с количеством микросостояний через формулу Больцмана.

- Энтропия используется не только в физике, но и в теории информации — как мера неопределённости.

- В живых организмах локальное снижение энтропии возможно за счёт увеличения энтропии окружающей среды.