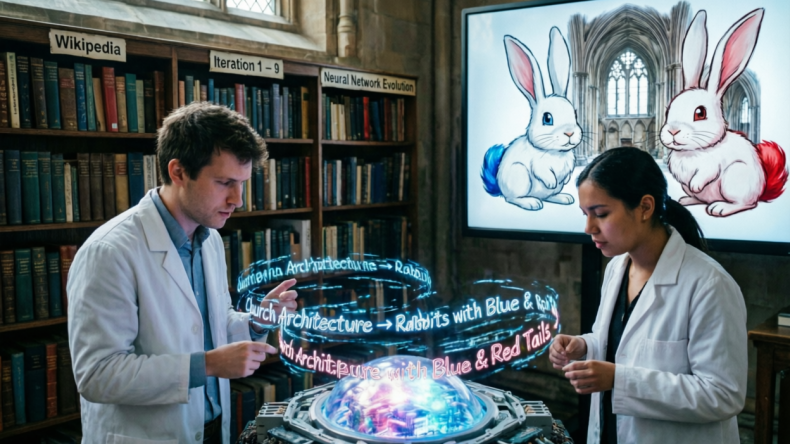

Ученые из Оксфорда, Кембриджа и Торонто решили проверить, что будет, если нейросеть будет обучаться только на собственных текстах. В ходе эксперимента модель сначала дообучили на статьях из Википедии, затем попросили сгенерировать новые тексты, на которых обучили следующую версию – и так несколько раз подряд. Уже после девятого цикла обучения нейросеть начала выдавать абсурдные ответы: например, вместо описания церковной архитектуры писала о зайцах с синими и красными хвостами. Этот эффект назвали «коллапсом модели» – искусственный интеллект с каждым новым циклом все сильнее искажает исходные данные.

Однако позже эксперты отметили: в реальности разработчики не используют только синтетические тексты. Обычно их смешивают с человеческими, и это снижает риск ошибок. В 2025 году другая группа исследователей провела новый эксперимент и выяснила: если датасет состоит на две трети из обычных текстов и на треть – из переписанных нейросетью, обучение идёт гораздо быстрее. Сгенерированные тексты чище и структурированнее, а человеческие – сохраняют языковое разнообразие.

Поэтому созданные человеком тексты по-прежнему остаются стратегическим ресурсом. Крупные компании скупают архивы газет, заключают контракты с платформами вроде Reddit и нанимают экспертов для написания узкоспециализированных материалов.

Тем не менее, развитие нейросетей все меньше зависит от объема скормленных им текстов. Сегодня значительный прогресс достигается за счет обучения рассуждениям, использования синтетических задач и методов обучения с подкреплением (RL). Дефицит человеческих данных остается проблемой, но уже не выглядит непреодолимым барьером для развития искусственного интеллекта.